数据中心液冷技术革命:从浸没式到冷板式,如何重塑基础设施能效与服务器托管安全

随着AI与高性能计算负载激增,传统风冷已触及散热天花板。数据中心液冷技术,特别是浸没式与冷板式,正引领一场深刻的能效革命。本文深度解析两种主流液冷技术的原理、能效对比与部署挑战,并探讨其在提升数据中心PUE、优化服务器托管密度以及增强关键硬件数据安全方面的实用价值,为基础设施决策者提供关键考量维度。

1. 风冷瓶颈与液冷崛起:数据中心基础设施的必然选择

芬兰影视网 在算力需求爆炸式增长的今天,数据中心已成为数字经济的核心基础设施。然而,传统风冷散热方式正面临严峻挑战:高密度服务器机柜功率超过20kW甚至30kW时,空气散热效率急剧下降,导致机房温度失控、能耗激增。这不仅推高了运营成本,更限制了计算密度的提升。在此背景下,液冷技术凭借其远超空气的导热能力(比热容高数千倍),从边缘创新走向主流。它不仅是降低功耗(PUE可趋近于1.1甚至更低)的关键,更是支撑未来AI训练、科学计算等关键负载在服务器托管环境中稳定运行的基础。这场能效革命直接关乎企业IT基础设施的可持续性与竞争力。

2. 技术深度解析:冷板式与浸没式液冷的原理与效能对比

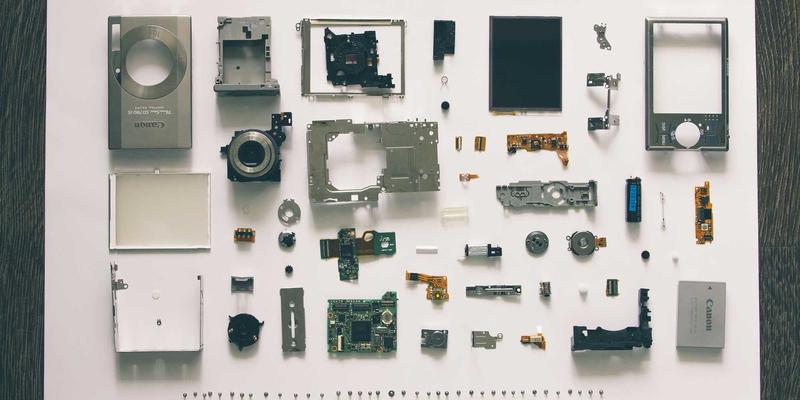

当前主流的液冷路径主要分为冷板式与浸没式,两者在技术实现和适用场景上各有千秋。 **冷板式液冷**:属于间接接触式冷却。其核心是在服务器CPU、GPU等高发热元件上安装密闭的冷板,内部流通冷却液(通常为去离子水)。热量由芯片传导至冷板,再被液体带走,送至室外冷却塔或干冷器进行散热。其优势在于对现有服务器架构改造相对较小,主要更换散热模块即可,部署灵活性较高,更易于在现有数据中心基础设施中分阶段引入。 **浸没式液冷**:则更为彻底,属于直接接触式冷却。它将整个服务器或主要发热部件完全浸没在绝缘、不导电的冷却液(如矿物油、氟化液)中。热量通过液体自然对流或泵驱动循环直接传递出去。这种方式散热效率极高,可几乎完全消除风扇能耗,实现极致的PUE,并大幅降低服务器运行噪音。 **能效与密度对决**:浸没式在极限能效和单机柜密度(可轻松支持100kW以上)上通常优于冷板式。但冷板式在与传统基础设施兼容、维护便利性及初期部署成本上往往更具优势。

3. 超越散热:液冷技术对服务器托管与数据安全的双重赋能

液冷技术的价值远不止于节能降耗,它深刻影响着服务器托管服务模式与数据安全层面。 在**服务器托管**领域,液冷技术意味着托管服务商可以在相同的物理空间内为客户部署更高密度的算力,极大提升了单机柜的价值和数据中心整体产出。同时,更稳定、低温的运行环境能显著延长服务器硬件寿命,提升托管服务的可靠性与客户资产价值。 在**数据安全**层面,液冷技术带来了物理层面的新保障。首先,浸没式液冷所使用的绝缘液体,创造了缺氧、恒温、恒湿的稳定环境,能有效防止大气中的灰尘、湿气对精密电路的腐蚀,降低了硬件故障导致数据丢失的风险。其次,该环境也天然具备一定的物理隔离性,增加了非授权接触硬件的难度。更重要的是,稳定的低温运行极大减少了因过热导致的意外宕机,保障了业务连续性与数据可用性,这对于金融、科研等涉及核心数据资产的应用场景至关重要。

4. 部署考量与实践指南:基础设施决策者的关键 checklist

引入液冷技术是一项系统性工程,需从多维度审慎评估: 1. **负载与业务匹配度**:评估当前与未来的工作负载。AI集群、高性能计算等持续高负载场景是浸没式的理想选择;而对于负载波动较大、或需兼顾通用计算的混合场景,冷板式可能是更平稳的起点。 2. **基础设施兼容性与改造**:评估现有数据中心基础设施的承接能力。浸没式需专用的机柜、液体分配单元、液体存储与过滤系统,对机房承重、泄漏检测、消防系统要求全新设计。冷板式则需关注供水管路部署、快速接头可靠性以及后备冷却方案。 3. **总拥有成本分析**:不仅比较初期资本支出,更需计算长期的运营收益。包括电力节省(PUE降低)、水资源消耗(部分系统需用水)、冷却液维护/更换成本、以及因密度提升而节省的空间成本。 4. **运维与供应链准备**:团队是否具备新技术的运维能力?冷却液的采购、处理与回收链条是否畅通?服务器厂商能否提供完善的液冷服务器产品线与技术支持? 5. **安全与标准合规**:制定严格的泄漏监测与应急预案。关注并遵循国内外关于液体冷却数据中心的设计、安装和运维的相关标准与最佳实践。 明智的部署策略往往是混合与分阶段的,例如在核心高密度区域采用浸没式,在其余区域采用冷板式或先进风冷,以实现整体基础设施的能效最优与风险可控。